Vad är överanpassning (overfitting)? När AI blir för bra på träning – men sämre i verkligheten

Overfitting förklarat enkelt – varför AI kan prestera bra i test men dåligt i verkligheten. Vad är överanpassning inom AI?

Här får du en tydlig och djupgående förklaring av overfitting, varför det händer och hur man försöker undvika det. Det räcker inte att vara bra på det man redan sett. Det viktiga är att klara det nya.

Vad är överanpassning (overfitting)?

Överanpassning, eller overfitting, betyder att en AI-modell har lärt sig träningsdatan för exakt – så exakt att den fungerar sämre när den möter ny information.

Modellen blir alltså mycket bra på det den tränats på, men sämre på verkliga situationer.

Det är ett vanligt problem inom machine learning och en viktig sak att förstå om man vill veta hur AI fungerar på riktigt.

Ett enkelt exempel

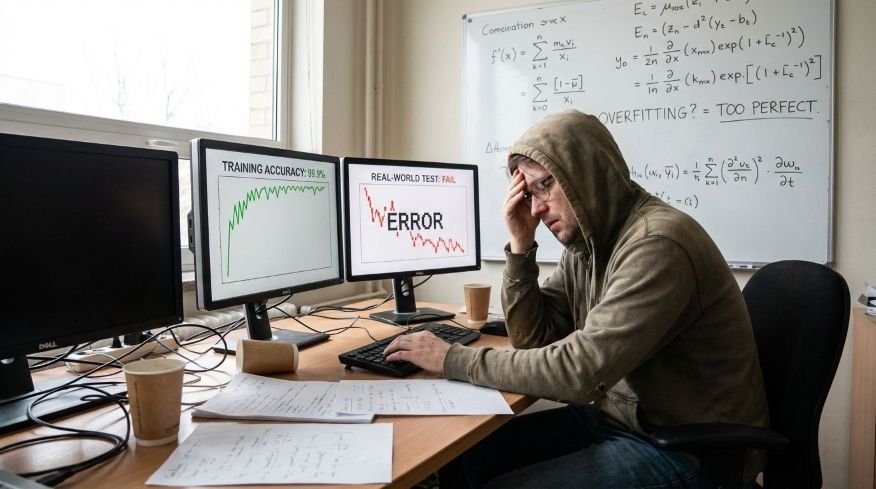

Egen Bild: Vad är overfitting?

Tänk dig en elev som memorerar gamla provfrågor ord för ord.

Om exakt samma frågor kommer på nästa prov går det bra.

Men om frågorna ändras lite blir det svårt.

Det är ungefär så överanpassning fungerar.

AI:n har lärt sig detaljerna i träningsmaterialet – men inte den djupare principen.

Läs mer om: AI-begrepp • AI-ordlista A–Ö

Varför händer det?

När en modell tränas försöker den minska fel och bli bättre.

Men ibland fortsätter träningen så långt att modellen inte bara lär sig viktiga mönster, utan också:

- slumpmässiga detaljer

- brus i datan

- unika undantag

- irrelevanta samband

Då blir modellen för specialiserad på just träningsdatan.

Hur märker man overfitting?

Ett klassiskt tecken är:

- mycket bra resultat på träningsdata

- betydligt sämre resultat på ny testdata

Det ser alltså starkt ut i utvecklingen – men svagare när modellen används i verkligheten.

Exempel i praktiken

Bildigenkänning

En modell tränas att känna igen hundar. Men den råkar fokusera på bakgrunden i träningsbilderna istället för hundarna själva.

När nya bilder har annan bakgrund misslyckas modellen.

Spamfilter

Modellen lär sig att vissa ord alltid betyder spam. Men riktiga mejl kan också innehålla dessa ord.

Försäljning

En modell tror att en tillfällig kampanjtrend är en permanent regel och gör dåliga framtidsprognoser.

Varför är detta viktigt?

Målet med AI är inte att minnas träningsdatan. Målet är att generalisera – alltså fungera på nya exempel.

Det är där verkligt värde skapas.

En modell som bara är bra på historiken är ofta mindre användbar än den verkar.

Underfitting vs overfitting

Underfitting

Modellen är för enkel och lär sig för lite.

Overfitting

Modellen lär sig för mycket detaljer och tappar flexibilitet.

Det bästa läget ligger ofta någonstans mellan dessa ytterligheter.

Hur försöker man undvika överanpassning?

1. Mer och bättre data

Mer varierad data gör det svårare för modellen att fastna i detaljer.

2. Valideringsdata

Man testar modellen på data den inte tränats på under utvecklingen.

3. Tidig stoppning

Träningen stoppas innan modellen börjar överanpassa sig.

4. Förenkla modellen

Ibland är en enklare modell bättre än en för avancerad.

5. Regularisering

Tekniker som minskar risken att modellen blir för komplex.

En viktig verklighetsdetalj

Större modeller är inte automatiskt bättre.

Mer kraft kan ge bättre resultat – men också ökad risk för att lära sig fel saker om processen inte hanteras rätt.

Det är därför kvalitet i data och testning är så viktigt.

Läs mer om: AI-begrepp • AI för nybörjare

Vad betyder detta för vanliga användare?

Du kanske inte tränar modeller själv, men principen påverkar verktygen du använder.

Om en AI-tjänst känns stark i vissa exempel men svag i verkliga situationer kan överanpassning vara en del av förklaringen.

Det visar varför AI-utveckling är mer än bara “gör modellen större”.

Kan språkmodeller drabbas av overfitting?

Ja, även stora språkmodeller behöver balanseras så att de inte bara reproducerar träningsmönster på ett smalt sätt.

Därför används avancerade metoder för testning, finjustering och utvärdering.

Egen Bild: Vad är överanpassning?

Vanliga frågor

Vad betyder overfitting på svenska?

Överanpassning.

Är overfitting ett fel?

Det är ett vanligt problem i modellträning, inte en enkel “bugg”.

Hur vet man om en modell har overfitting?

När den presterar mycket bättre på träningsdata än på ny data.

Kan man helt undvika det?

Man kan minska risken kraftigt, men det kräver bra arbete med data och testning.

Är detta viktigt utanför AI-världen?

Ja, principen gäller många typer av prognoser och beslutsmodeller.

Relaterade begrepp & sammanhang

Läs vidare här:

Vad är machine learning? • Hur tränas AI?

Vad är data? • Vad är en AI-modell?

Avslutning

Överanpassning är en viktig påminnelse om att AI inte bara handlar om att prestera bra i träning.

Det handlar om att fungera i verkligheten, med nya situationer, nya människor och ny data.

En modell som lär sig för exakt kan se imponerande ut på papper – men ge svagare resultat där det verkligen räknas.

Och därför är overfitting ett av de mest centrala begreppen att förstå inom modern AI.

AI-begrepp • AI för nybörjare

Artikeln är sammanställd av Petter, som driver AIhjalp.se som ett informationsprojekt kring AI och praktisk användning i vardagen.

Innehållet bygger på tester, egna erfarenheter och öppna källor, med fokus på att göra AI enklare att förstå och använda – utan krångel.